ChatGPT預示了人們對AI解放人手、快速提供智慧服務的渴望,其衍生的相關應用服務與模型訓練,將進一步加大高效能運算與資料中心缺口,拉動半導體需求。

2022年11月底,美國OpenAI公司推出ChatGPT「聊天機器人」,瞬間暴紅,推出後短短2個月,活躍用戶數就超過1億人。對比之下,TiTok花了9個月、Instagram花了30個月、WhatsApp花了42個月、Facebook花了54個月、Twitter花了90個月,才分別達到1億戶的活躍用戶,ChatGPT暴紅的程度令人注目。

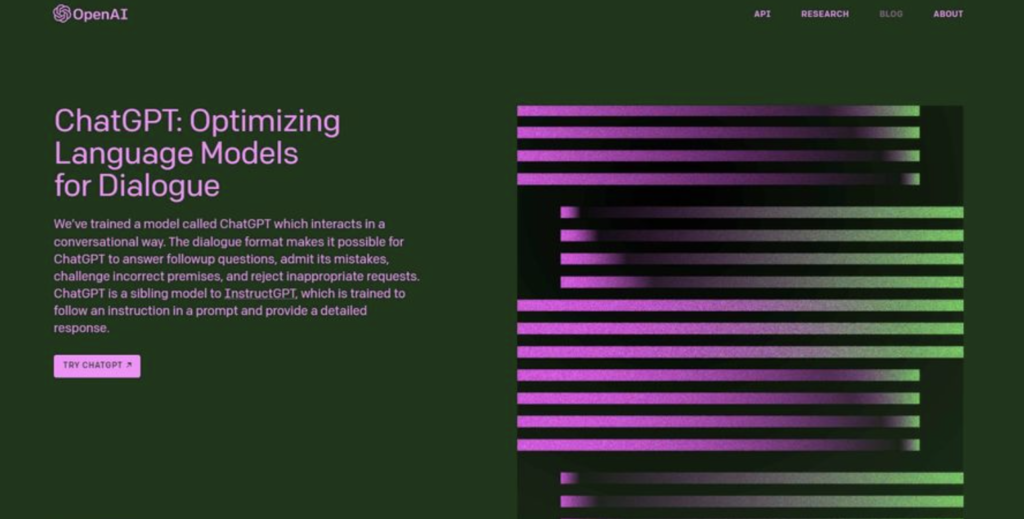

以前的聊天機器人似乎也能回答使用者問題、撰寫文件,不同的是ChatGPT以幾乎是「真人」的口吻透過文字與使用者對話,而且可廣泛地完成各種功能。

ChatGPT是「大型自然語言模型」的產物,它透過巨量的文本資料,預先以深度學習訓練加上「微調」,然後產生一套規模宏大的模型參數,以類神經網路的方式,構成的人工智慧聊天機器人。

NVIDIA黃仁勳:ChatGPT如人工智慧應用的iPhone時刻

輝達執行長黃仁勳,在美國加州柏克萊大學海斯學院對學生演講時,學生詢問及ChatGPT,黃仁勳十分興奮稱,ChatGPT宛如人工智慧(AI)界的iPhone。由於iPhone推出後,顛覆手機產業的面貌,讓智慧型手機提升到前所未有的應用,擴大人類的視野。iPhone可說是智慧型手機起飛的重要里程碑。

黃仁勳將ChatGPT譽為AI的iPhone,象徵自ChatGPT之後,AI將邁開大步前進。黃仁勳說ChatGPT可以寫一首詩、可以填寫電子表格、可以編寫SQL(結構式查詢語言)程式並執行SQL查詢、可以編寫Python語言程式、也可以編寫Verilog語言(IC設計慣用的程式語言)程式。

一般人士可以透過自然的語言,要求ChatGPT產生專業的需求(例如上述撰寫程式語言),使普通人也可以具備專業工程師的能力。ChatGPT可以根據使用者輸入的要求,撰寫廣告文案、演講稿、劇本、歌詞、整理資料製作表格等等。

2022年11月底,美國OpenAI公司推出ChatGPT「聊天機器人」,瞬間暴紅,推出後短短2個月,活躍用戶數就超過1億人。對比之下,TiTok花了9個月、Instagram花了30個月、WhatsApp花了42個月、Facebook花了54個月、Twitter花了90個月,才分別達到1億戶的活躍用戶,ChatGPT暴紅的程度令人注目。

以前的聊天機器人似乎也能回答使用者問題、撰寫文件,不同的是ChatGPT以幾乎是「真人」的口吻透過文字與使用者對話,而且可廣泛地完成各種功能。

來源:Shutterstock

ChatGPT是「大型自然語言模型」的產物,它透過巨量的文本資料,預先以深度學習訓練加上「微調」,然後產生一套規模宏大的模型參數,以類神經網路的方式,構成的人工智慧聊天機器人。

NVIDIA黃仁勳:ChatGPT如人工智慧應用的iPhone時刻

輝達執行長黃仁勳,在美國加州柏克萊大學海斯學院對學生演講時,學生詢問及ChatGPT,黃仁勳十分興奮稱,ChatGPT宛如人工智慧(AI)界的iPhone。由於iPhone推出後,顛覆手機產業的面貌,讓智慧型手機提升到前所未有的應用,擴大人類的視野。iPhone可說是智慧型手機起飛的重要里程碑。

掌握最新AI、5G、區塊鏈應用!免費訂閱《數位時代》日報及社群活動資訊

黃仁勳將ChatGPT譽為AI的iPhone,象徵自ChatGPT之後,AI將邁開大步前進。黃仁勳說ChatGPT可以寫一首詩、可以填寫電子表格、可以編寫SQL(結構式查詢語言)程式並執行SQL查詢、可以編寫Python語言程式、也可以編寫Verilog語言(IC設計慣用的程式語言)程式。

一般人士可以透過自然的語言,要求ChatGPT產生專業的需求(例如上述撰寫程式語言),使普通人也可以具備專業工程師的能力。ChatGPT可以根據使用者輸入的要求,撰寫廣告文案、演講稿、劇本、歌詞、整理資料製作表格等等。

來源:shutterstock

這一切似乎很夢幻,目前ChatGPT雖能達成許多各式各樣的功能,不過尚無法盡善盡美,尚有很多需要調整的空間。目前已有超過500家以上的新創公司基於ChatGPT的平台,開發各式各樣的應用,假以時日將會有更多顛覆性的創新。

ChatGPT是許多研究機構與大量數據、模型投入計算後的產物

開發出ChatGPT的OpenAI成立於2015年,是一家專注於人工智慧研發的實驗室。自然語言處理(NLP)在人工智慧的應用發展,占有很重要的地位,全球很多人工智慧研究機構皆專注於NLP的研究。

2018年「華盛頓大學」及「艾倫人工智慧研究所」的研究人員,提出一種新的自然語言訓練模型,這種模型採取預先訓練大量「無標註」的數據加以訓練,這可節省大量訓練的時間與金錢。

經過預先的訓練後,可得到一套模型參數,這套參數可套用到實際運用的任務上。OpenAI將這種預先訓練方式加以改良,除了無標註資料外,並增加少量標註的語料,作為微調,並且在預先訓練中加入一層「變換器」模型(Transformer)。OpenAI將發展出這個NLP模型,稱之為GPT(Generative Pre-training Transformer,生成式預先訓練變換器)。

第一代GPT於2018年6月發表,具有1.17億個參數,顯而易見的是參數的數目愈多,代表預先訓練的語料愈多,處理功能也愈強。由於參數數目不夠大,因此第一代GPT表現不太出色。

2019年2月,OpenAI發表GPT-2,為了增加通用性,GPT-2將用於預先訓練的資料擴大,選擇範圍更廣、品質更高的數據,用800萬網頁的語料訓練,幾乎涵蓋所有領域。GPT-2的參數增加到15億個,做自然語言處理任務時,可以具有聊天、閱讀摘要、翻譯、編故事等功能。

2020年5月OpenAI推出GPT-3,預先訓練規模大幅擴大,需要的運算力大幅增加,費用也大幅攀升。為了支撐龐大的研發費用,微軟於2019年7月對OpenAI投資10億美元,並且提供運算資源。微軟預計可能總共將投資OpenAI 100億美元,AI的研發需要龐大的資源與經費。

GPT-3版本使用到45TB壓縮的文本,作為預先訓練資料,參數的數目大增到1,750億個(需要800GB存儲)‘,是有史以來參數最多的人工智慧類神經網路模型。

ChatCPT所衍生的相關應用,將推升高效能運算與資料中心的需求

為了支援這龐大的運算,微軟於2020年5月推出專為OpenAI設計的超級電腦,將之放在Azure,此超級電腦包括超過28.5萬個處理器內核,以及1萬個GPU以每秒400Gb的速度連接,以運算力來看,可排名為全球第5大超級電腦。

GPT-3為自我監督的語言模型,可以完成自然語言處理的絕大部分任務,將網頁描述轉換為相對應代碼,模仿人類敘事,創作訂製詩歌,生成遊戲劇本等等。

2022年1月OpenAI推出InstructGPT,這是GPT-3的小幅升級版本,主要是將不真實、有害、有偏差的輸出最小化。

2022年11月30日ChatGPT問世,以演進的過程來看,是InstructGPT進一步的升級版本,將使用者的回饋納入訓練過程,可以讓模型輸出與使用者意圖保持一致。

由此發展的脈絡來看,即便ChatGPT已讓全球驚豔,繼ChatGPT之後,應該會推出功能更加強大的GPT-4,參數數目將可能超過兆個,透過大型語言模型應用的人工智慧將更上層樓。

人工智慧是由高效能運算、高速網路連結及龐大的記憶體儲存空間的支援而成,人工智慧的進步,有賴更高性能的半導體,ChatGPT的問世將點燃高效能運算需求的另一把火。

Leave a Review